- トップ

- 企業・教材・サービス

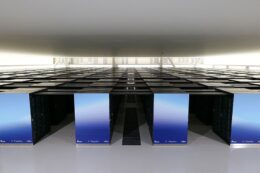

- スーパーコンピュータ「富岳」で学習した大規模言語モデル「Fugaku-LLM」を公開

2024年5月14日

スーパーコンピュータ「富岳」で学習した大規模言語モデル「Fugaku-LLM」を公開

東京工業大学、東北大学、富士通 人工知能研究所、理化学研究所、名古屋大学、サイバーエージェント、Kotoba Technologiesは、スーパーコンピュータ「富岳」で学習した大規模言語モデル「Fugaku-LLM」を5月10日に公開した。

深層学習フレームワークを「富岳」に移植してTransformerの性能を「富岳」上で最適化し、並列分散学習手法を開発・適用することで、大規模言語モデルの学習を行う際の演算速度を6倍に高速化した。

さらに、「富岳」向けにTofuインターコネクトD上での集団通信の最適化を行うことにより、通信速度を3倍高速化することに成功。これにより「富岳」のCPUを用いて、現実的な時間内で大規模言語モデルを学習することが可能になったという。

Fugaku-LLMは国内で多く開発されている70億パラメータより高性能、かつ扱いやすい130億パラメータのモデル。学習では、サイバーエージェントが収集した独自の日本語学習データと英語のデータなどを用いているため、日本語性能にも優れ、特に人文社会系のタスクでは高いベンチマーク性能を発揮するという。

Fugaku-LLMは、GitHubやHugging Faceを通じ公開していて、ライセンスに従う限り、研究および商業目的での利用が可能。

関連URL

最新ニュース

- C&R社、離職者等再就職訓練「キャリアアドバイザー・コーディネーター(オンライン)科」受講生募集(2026年6月5日)

- コニカミノルタ、学校向けソリューション「tomoLinks」のAIドリル機能が岐阜・大垣市に導入(2026年6月5日)

- 大阪電気通信大学、大阪府立工科高5校と次世代高度技術者育成に向けた高大連携覚書を締結(2026年6月5日)

- 中高生の登校しぶり、約8割の保護者は「子どもの言葉や欠席などの行動」で初めて気づく =塾選調べ=(2026年6月5日)

- 東京大学松尾研、「大規模言語モデル講座」受講生募集&2025年度講義資料を無料公開(2026年6月5日)

- 金沢工業大学、AIやIoTを基礎から応用まで学ぶ「情報技術教育プログラム」開講(2026年6月5日)

- 京都橘大学、情報学研究科の学生チーム「KTU」がロボカップ世界大会に出場(2026年6月5日)

- ATOMica×大阪ガス、探究学習支援プログラム「Socialium」を明星高等学校に導入(2026年6月5日)

- NVIDIA、学術研究向けに「NVIDIA Isaac GR00T Reference Humanoid Robot」を発表(2026年6月5日)

- 女の子のためのプログラミングスクール「griteen」、作品発表会を実施(2026年6月5日)